图片来源:DeepSeek

DeepSeek正与清华大学合作,致力于减少其AI模型所需的训练量,以降低运营成本,开发自我进化的AI模型。

DeepSeek 曾以一月份推出的低成本推理模型震动市场,现与高校研究人员联合发表论文,详述了一种提升模型效率的强化学习新路径。研究人员写道,这种新方法旨在通过为更准确且易于理解的回答提供奖励,帮助人工智能模型更好地遵循人类偏好。

强化学习在加速特定应用和领域内的AI任务方面已被证明有效,但将其扩展到更通用的场景一直充满挑战——这正是DeepSeek 团队试图通过其所谓的“自我原则批判调优“来解决的问题。

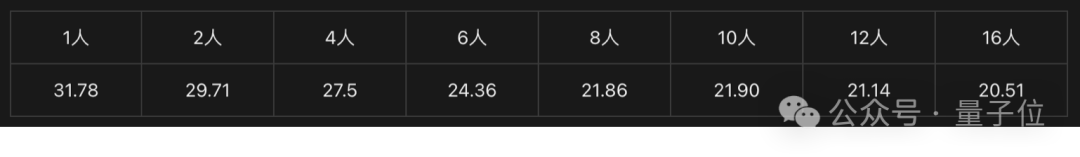

论文指出,该策略在多项基准测试中超越了现有方法和模型,结果显示能以更少的计算资源实现更优性能。

DeepSeek公司表示,将这些新模型命名为DeepSeek-GRM(通用奖励建模的缩写),并将以开源形式发布。

包括中国科技巨头阿里巴巴集团和美国旧金山的OpenAI在内的其他AI开发者,也正在开拓新领域,致力于提升AI模型实时执行任务时的推理与自我优化能力。

Meta于上周末发布了其最新AI模型系列Llama 4,并宣称这是其首个采用混合专家(MoE)架构的模型。深度求索(DeepSeek)的模型高度依赖MoE技术以实现资源的高效利用。

Meta在发布新品时对标了这家杭州初创企业。DeepSeek 尚未透露其下一代旗舰模型的发布时间。

论文链接:https://arxiv.org/abs/2501.12948

参考资料

本文翻译自:https://www.bloomberg.com/news/articles/2025-04-07/deepseek-and-tsinghua-developing-self-improving-ai-models?srnd=phx-technology

编译:ChatGPT

(文:Z Potentials)